动机

- 现有的图像超分,一般使用确定的操作对高分辨率图像进行降采样得到配对的数据,但这样的方法使得得到的低分辨率图像跟真实世界的低分辨率图像差异很大;

- 对于非配对的方法则存在不同程度的缺点。

贡献

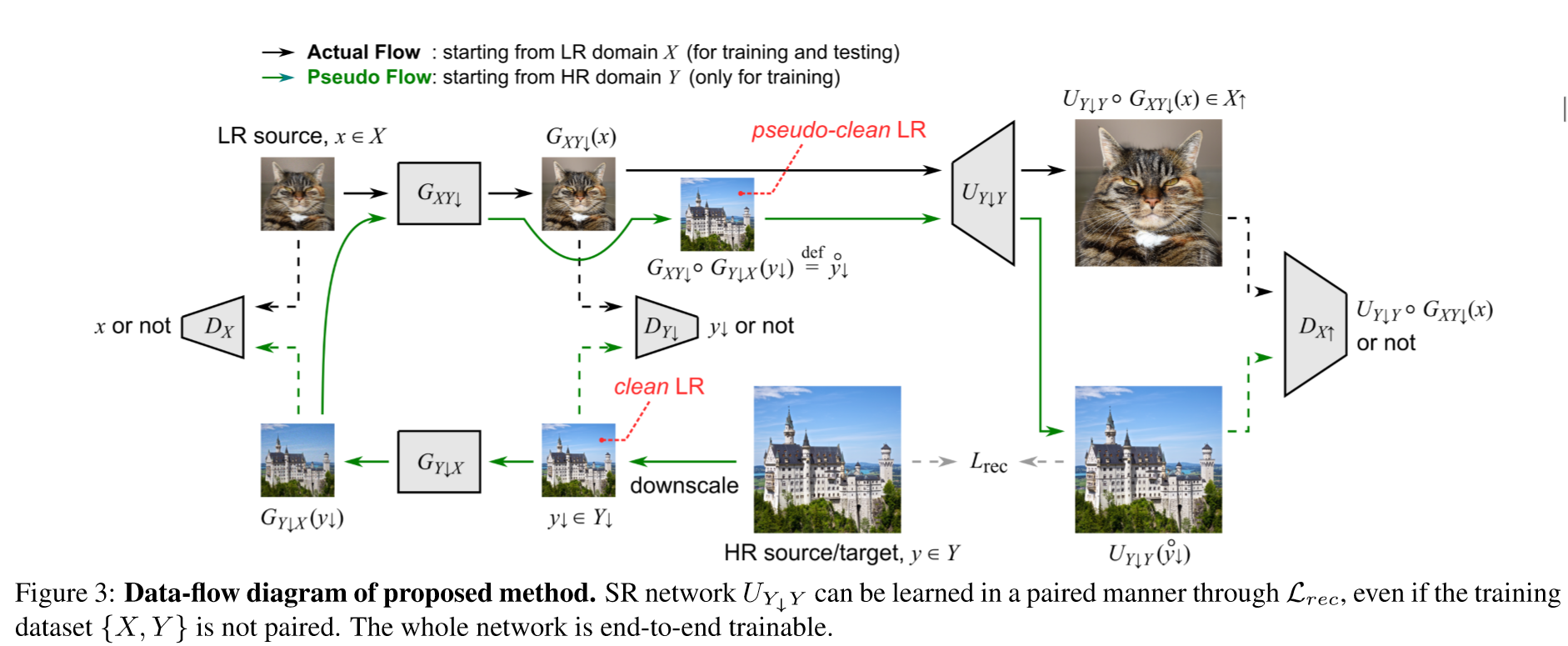

- 本文提出一种使用GAN网络进行非配对训练的超分方法,网络由一个非配对的噪声校正网络和一个伪配对SR网络组成。

- 校正网络去除噪声,调整输入LR图像的核;然后,通过SR网络对校正后的clean LR图像进行上采样。在训练阶段,校正网络也从输入的HR图像中生成一个伪clean LR图像,然后由SR网络配对学习伪clean LR图像到输入HR图像的映射。由于本文的SR网络是独立于校正网络的,现有网络架构和像素级损失函数可以与提出的框架集成。

- 在不同数据集上的实验表明,该方法优于现有的解决方法。

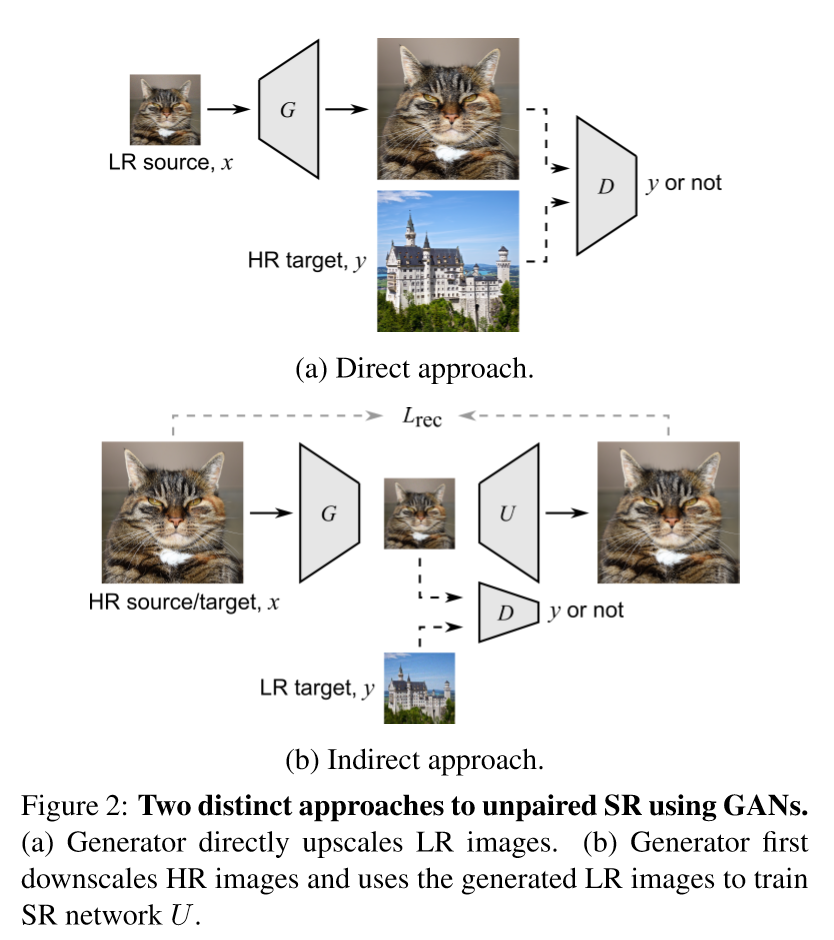

以前的不使用成对图像的方法

- 第一种是直接方法:由生成器学习LR到HR的图像,然后跟真实的HR图像送入判别器判别,缺点是不能使用像素级的loss来训练生成器,导致生成的HR图像效果不佳;

- 第二种是非直接方法:由真实的HR图像通过生成器生成LR图像,再通过与真实的LR图像进行判别,同时另一个生成器学习从逼近的真实的LR图像到HR图像的生成,缺点是如果生成器生成的LR图像与真实世界的LR图像差别较大,则会导致测试时生成的HR图像效果不佳

本文的方法

同时克服了上述两种方法的缺点,将整个网络分离为一个未配对的核/噪声校正网络和一个伪配对的SR网络(图3)。

校正网络(基于cyclegan)

真实的HR的图像经过下采样和添加高斯模糊核等生成一个clean LR,然后通过Gyx与真实的LR图像对抗训练(相当于Gyx在进行内核校正和添加噪声,使得生成的LR图像和真实的LR图像在各个位置上的模糊程度和噪声基本相同);

然后Gxy由真实的LR图像生成伪clean LR图像并与clean LR图像对抗训练(相当于Gxy学习去噪和去模糊的过程)

超分网络

将生成的伪clean LR图像输入一个上采样网络去生成SR图像,同时利用了真实的HR图像退化后的LR图像生成伪clean LR图像再上采样得到HR图像,可以引入像素的损失,同时做对抗训练,希望生成的SR图像跟真实世界的SR图像相似

损失函数

两个经典GAN的损失

cyclegan的循环一致性损失

身份匹配损失:(避免色差等,其实就是为了避免经过去噪网络后像素差异过大)

几何损失:为了保证旋转和翻转后的图片不会改变结果,其实就是约束去噪过程的一致性,可以理解为一张图片,经过八组不同的改变,再经过Gxy,最后结果是一致的

总的损失:

L1损失:

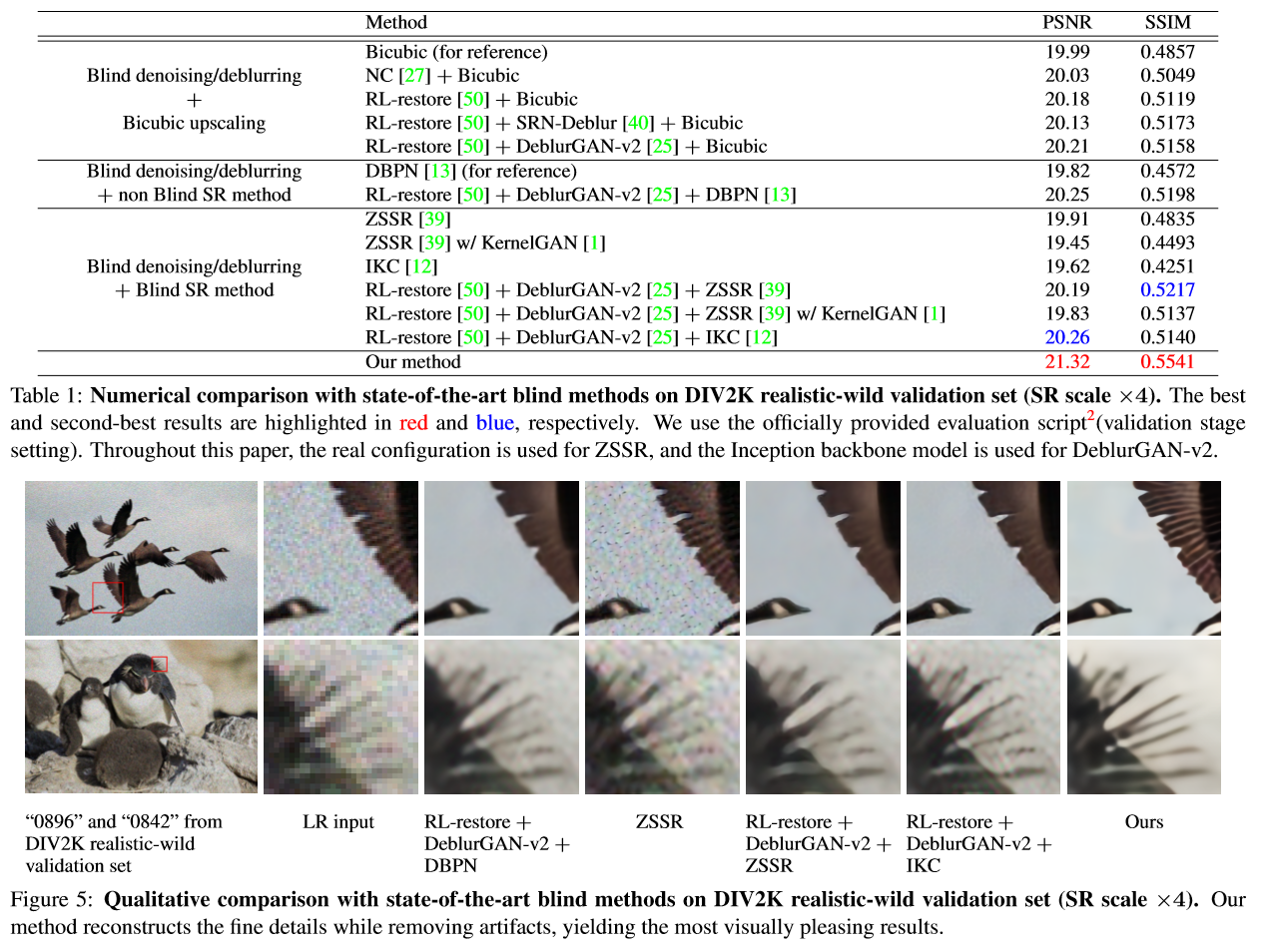

部分实验结果

通过对比其它的方法,在DIV2K数据集上可以看出,在峰值信噪比和结构化相似度上均具有最好的值(值越大说明失真度越小),同时在图片质量上可以看出去噪能力更强

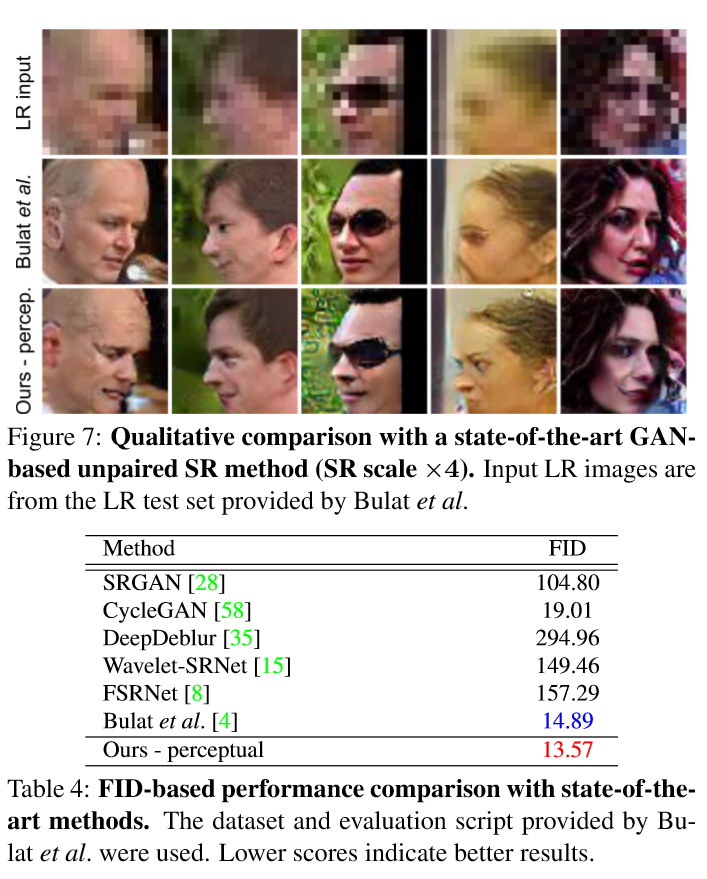

对比其它的基于GAN的非配对超分方法,可以看出在FID上的实验效果也是最好的